Apple được cho là sẽ giới thiệu một tính năng mới trong bản cập nhật iOS 18.2 sắp tới nhằm bảo vệ đạo đức và sức khỏe tinh thần của trẻ em.

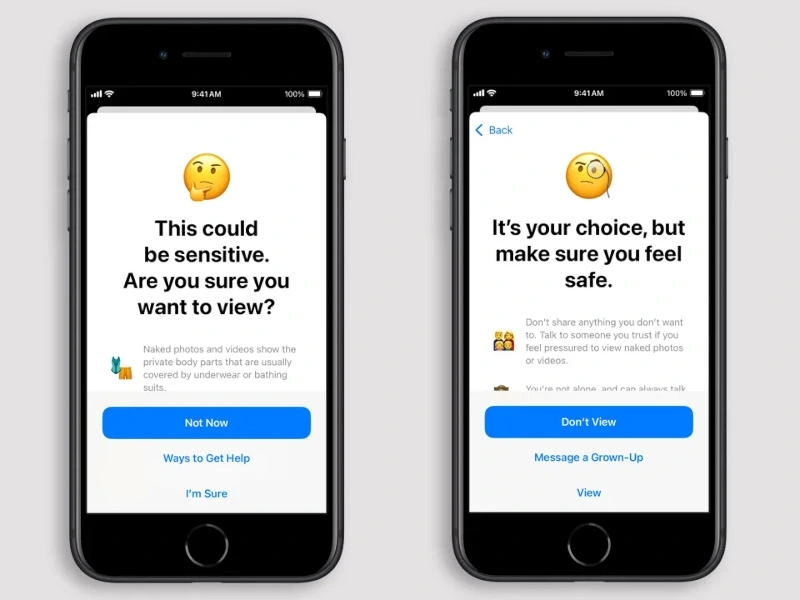

Tính năng bảo vệ trẻ em này của iOS 18.2 sẽ tự động phát hiện hình ảnh khỏa thân, sau đó áp dụng hiệu ứng làm mờ và hiển thị cảnh báo yêu cầu người dùng xác nhận trước khi tiếp tục truy cập vào nội dung nhạy cảm, với yêu cầu nhập mật khẩu để tiếp tục.

Cách tính năng bảo vệ trẻ em hoạt động

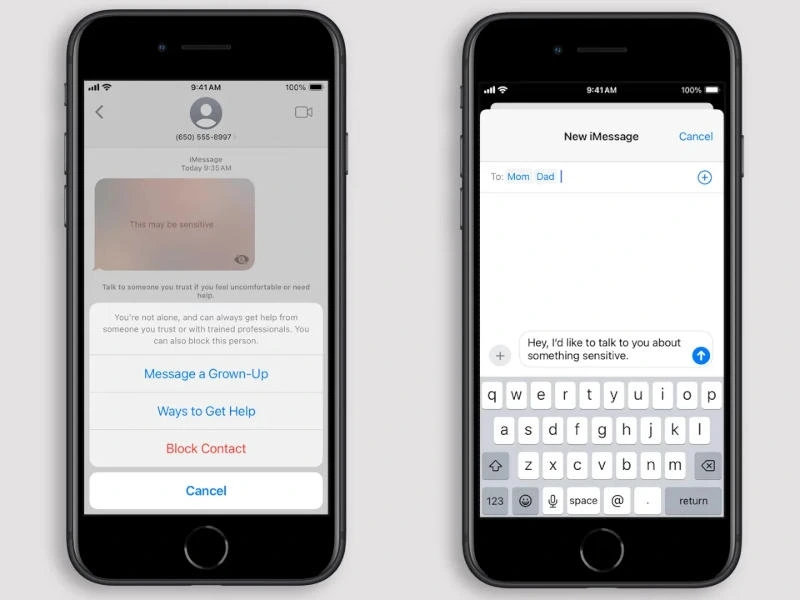

Điểm đáng chú ý là tính năng này không ảnh hưởng đến mã hóa đầu cuối và không chứa cửa hậu cho các cơ quan chức năng truy cập. Dựa trên thuật toán học máy, khi phát hiện ảnh khỏa thân, hệ thống sẽ thông báo về tính chất nhạy cảm của nội dung và cung cấp các tùy chọn cho người sử dụng, bao gồm việc chặn người đối thoại hoặc truy cập các tài nguyên bảo mật trực tuyến. Ngoài ra, người truy cập nội dung cũng có thể gửi cảnh báo cho phụ huynh hoặc người giám hộ.

Tính năng này sẽ được áp dụng trên iPhone và iPad, mang đến khả năng phân tích hình ảnh trong các ứng dụng như Tin nhắn, AirDrop, FaceTime và một số ứng dụng bên thứ ba có khả năng chia sẻ ảnh hoặc video. Các thiết bị khác như MacBook, smartwatch và tai nghe Vision Pro cũng sẽ hỗ trợ tính năng này với yêu cầu cài đặt iOS 18, iPadOS 18, macOS 15 Sequoia hoặc VisionOS 2.

Tính năng này lần đầu tiên được triển khai tại Australia, nơi chính quyền đang xem xét áp dụng các quy định yêu cầu các công ty công nghệ kiểm soát tài liệu liên quan đến khủng bố và bạo lực đối với trẻ em “khi khả thi về mặt kỹ thuật”. Trước đó, vào năm 2021, Apple đã có kế hoạch triển khai một hệ thống phân tích nội dung trên điện thoại để tự động thông báo cho chính quyền về các sự cố có thể xảy ra. Tuy nhiên, do lo ngại về quyền riêng tư của người dùng và khả năng lạm dụng từ các chế độ độc tài, công ty đã quyết định từ bỏ sáng kiến này vào năm sau đó.